최근 수년간 전문 반도체 업체를 놔두고도 인공지능(AI)반도체에 대한 개발에 힘을 쏟는 기업들이 잇따르고 있다. 이런 가운데 여전히 많은 사람들은 AI 반도체라는 특화된 반도체가 필요한 이유에 대해 궁금해 한다. 또한 GPU(그래픽 처리 장치)업체 엔비디아와 AMD가 기존 컴퓨팅용 CPU(중앙 처리 장치) 강자인 인텔을 제치고 자율주행차용 AI칩 및 AI 훈련용 고성능 컴퓨터(슈퍼컴) 분야에서 강세를 보이는 이유에 대해서도 마찬가지일 것이다.

AI 알고리즘은 이미 오래 전부터 다양한 산업과 응용 분야에서 점점 더 널리 보급돼 오고 있다. 하지만 그 성능은 전통적인 CPU의 처리 능력에 의해 제한되는 경우가 많았다. AI 처리에는 이를 넘어서는 성능이 요구되기 때문이다. 또한 AI 알고리듬의 훈련 및 추론 단계에서 서로 다른 HW 요구 사항을 가지며, 두 단계 모두에 특화된 HW를 필요로 한다.

이에 일부 회사들은 AI 알고리즘의 성능을 향상시키기 위해 GPU와 구글의 AI 가속기인 텐서처리장치(TPU) 같은 새로운 하드웨어(HW) 제품을 개발하는가 하면 성능 향상에 매진하고 있다.

이 새로운 AI 프로세서들의 특징은 AI 알고리즘에 상당한 속도 향상을 제공하면서 더 나은 계산(연산)결과를 가져올 수 있다. 즉, 표준 CPU에 비해 AI에 최적화되고, 다양한 AI 요구 사항에 맞출 수 있는데다 기존 그래픽 기능보다 AI 학습 알고리즘 가속화 기능을 우선시 한다.

디코더닷컴은 지난주 인공지능(AI) 시대를 맞은 인류의 현재는 물론 미래의 삶과 산업에 점점 더 중요해져 가는 AI반도체에 대한 궁금증을 AI 반도체와 일반 반도체 간 차별성, 접근 방식, 장점, 사례 및 제조업체 별로 짚었다. 이를 소개한다.

표준 CPU보다 AI에 최적화···엔비디아가 AI칩 강자인 이유

컴퓨터의 CPU는 명령을 받아 실행하는 역할을 한다. 이는 컴퓨터의 심장이며, 이 칩의 클록 스피드는 컴퓨터의 계산 처리 속도를 결정한다.

AI 알고리즘과 같이 빈번하거나 강도 높은 연산이 필요한 작업의 경우 효율성을 향상시키기 위해 특수 HW가 사용된다. 이 HW는 일반적으로 서로 다른 알고리즘이나 입력을 사용하지 않지만, 많은 양의 데이터를 처리하고 향상된 컴퓨팅 성능을 제공하도록 특별하게 설계된다.

AI 알고리즘들은 새로운 AI 모델을 더 빨리 만들기 위해 종종 병렬 연산을 수행할 수 있는 프로세서에 의존한다.

특히 GPU의 경우 원래 그래픽 처리를 위한 연산용으로 설계됐지만 이미지 처리와 신경망 사이에서 보여지는 연상 작업의 유사성으로 인해 많은 AI 작업에 효과적인 것으로 입증됐다. GPU 세계 최강자인 엔비디아가 동시에 AI반도체 강자인 이유랄 수 있다.

이러한 프로세서들은 AI에 대한 성능을 최적화하기 위해 대량의 데이터를 효율적으로 처리하도록 조정될 수도 있다.

다양한 요구사항에 맞춘 AI HW···보드에서 GPU와 고속메모리 통합

AI 알고리즘을 훈련하고 사용하기 위한 HW 요구 사항은 크게 다를 수 있다. 대량의 데이터에서 패턴을 인식하는 훈련은 일반적으로 더 많은 처리 능력을 필요로 하며, 병렬화의 이점을 얻을 수 있다. 일단 AI 모델이 훈련되면 컴퓨팅(연산) 요구 사항이 감소할 수 있다.

이러한 다양한 요구를 충족하기 위해 일부 CPU 제조업체는 AI 모델 실행에 사용되는 특수한 AI 추론용 칩을 개발하고 있다. 물론 인텔같은 CPU 업체도 완전히 훈련된 AI 모델이 병렬 아키텍처로부터 이점을 얻는다는 것을 알고 있으며, 그런 가운데 AI칩 개발에 눈돌리고 있다.

전통적으로 PC업체들은 레이아웃에서 메모리와 CPU를 분리해 왔다. 그러나 GPU 제조사들은 AI 알고리즘 성능을 향상시키기 위해 고속 메모리를 보드에 직접 통합하는 방법을 사용했다. 이를 통해 컴퓨팅 집약적 AI 모델을 GPU 메모리에 직접 실어 실행할 수 있게 됐다. 그 결과데이터 전송에 소요되는 시간을 절약하고 더 빠른 산술 연산을 할 수 있다.

기존의 CPU와 GPU 외에도 스마트폰과 자동화 시스템과 같은 장치에서 사용할 수 있도록 설계된 소형 AI 칩도 있다. 이 칩들은 음성 인식과 같은 작업을 할 때 더 적은 전력을 소비하면서도 더 효율적으로 작업을 수행할 수 있다.

또한 일부 연구자들은 더 작은 공간에서 더 빠르고, 더 정확하고, 더 전력 효율적인 컴퓨팅의 잠재력을 제공하는 AI 계산을 위한 아날로그 전기 회로의 사용을 탐구하고 있다.

AI HW의 사례

GPU는 처리, 특히 기계 학습 작업에 사용되는 가장 일반적 AI HW로 남아있다. 앞서 언급된 광범위한 병렬화의 이점 때문에 GPU는 종종 CPU보다 수백 배 빠른 연산을 제공한다.

기계학습에 대한 수요가 지속적으로 증가함에 따라 IT 기업들은 기존 그래픽 기능보다 AI 학습 알고리즘 가속화를 우선시하는 특화된 HW 아키텍처를 개발하고 있다.

이 분야의 시장 선두 주자인 엔비디아는 전 세계 슈퍼컴퓨터(HPC)에 사용되는 A100과 H100 시스템과 같은 제품을 제공한다. 구글과 같은 다른 회사들도 특별히 AI에 활용하기 위해 자체적인 HW를 만들고 있는데, 그 결과물인 구글 텐서 처리 장치(TPU)는 현재 4세대에 이르고 있다.

이러한 일반화된 AI 칩 외에도 대용량 데이터를 처리하는 것 같은 기계학습 처리의 특정부분용으로 설계되거나, 스마트폰처럼 제한된 공간이나 배터리 수명을 가진 장치에서 사용되는 특화된 칩들도 있다.

여기에 더해 기존 CPU는 비록 정확도 저하를 의미하더라도 더 빠른 속도로 계산을 수행함으로써 기계학습 작업을 더 잘 처리할 수 있도록 적응하고 있다.

마지막으로, 많은 클라우드 서비스 공급자들도 컴퓨팅 집약적인 작업이 여러 컴퓨터와 프로세서에서 병렬로 실행되도록 허용하고 있다.

양대 AI 반도체 업체 vs 경쟁 IT기업들

머신러닝을 위한 GPU는 대부분 엔비디아와 AMD가 생산한다.

예를 들어 엔비디아는 기계학습 모델을 훈련할 때 이른바 ‘텐서 코어’를 사용해 더 정밀한 컴퓨팅 작업을 가능케 한다.

또한 H100 그래픽 카드는 4세대 텐서 코어와 FP8 정밀도의 트랜스포머 엔진을 탑재해 전문가 혼합(MoE) 모델을 이전 세대보다 최대 9배 더 빠르게 훈련한다.

AMD는 올해 나올 연산에 특화된 CDNA-2,CDNA-3 아키텍처를 사용해 GPU를 기계 학습 요구 사항에 맞게 조정하는 자체 접근 방식을 제공한다.

구글은 구글 클라우드 플랫폼을 통해 대여하고, 툴 및 라이브러리 제품군을 함께 제공하는 TPU로 순수 기계학습 가속화를 계속 선도하고 있다.

구글은 픽셀 스마트폰 계열을 포함한 모든 기계학습 기반 서비스를 TPU에 의존한다. 이 칩들은 음성 인식, 실시간 번역, 이미지 처리 같은 작업을 직접(클라우드 도움없이) 처리한다.

한편, 아마존, 오라클, IBM, 마이크로소프트(MS)와 같은 다른 주요 클라우드 제공자들은 GPU나 다른 AI HW를 선택했다.

아마존은 정확성보다 속도를 우선시하는 그라비톤(중력양자) 칩을 자체 개발했다.

구글 콜랩(Colab), MS의 머신러닝 스튜디오, IBM의 왓슨 스튜디오, 아마존의 세이지 메이커와 같은 프론트엔드 애플리케이션은 사용자들이 특화된 HW를 인식하지 않고도 이를 사용할 수 있게 해준다.

이 분야 전문 스타트업들도 AI칩 경쟁에 가세했다. AI훈련 및 추론에서 CPU보다 더 성능에서 앞선다는 GPU만이 능사가 아니라는 듯 새로운 기술로 성과를 내고 있는 기업들이 속속 등장하고 있다.

미국 캘리포니아 소재 D-매트릭스 같은 회사들이 산술 연산들을 메모리에 저장된 데이터에 더 가깝게 두는 인메모리 컴퓨팅(IMC) 칩을 생산하고 있다.

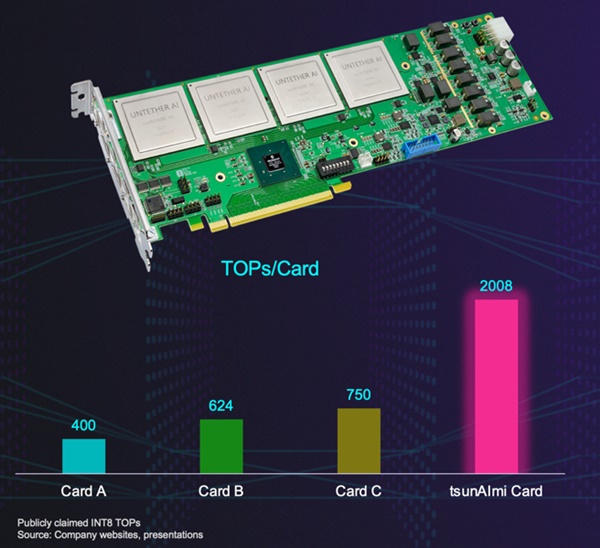

또 스타트업 언테터(Untether)는 이른바 ‘앳 메모리 컴퓨팅(at memory computing)’이라는 방식을 사용해 스마트카드 한 장에 2페타 옵스(1페타=1000조)라는 높은 컴퓨팅 파워를 구현하고 있다. 이 접근법은 램 셀에서 직접 계산하는 것을 포함한다. 언테터는 자사의 획기적인 앳 메모리 아키텍처가 컴퓨팅 요소를 직접 메모리 셀 부근으로 이동시킴으로써 타의 추종을 불허하는 컴퓨팅 밀도를 제공하며, 이를 통해 비전, 자연어 처리, 추천 엔진 등 다양한 신경망에 대한 AI 추론을 가속화한다고 말한다. 이 회사는 이 기술이 현재 자사의 ‘런AI200(runAI200)’ 디바이스 및 ‘쓰나이미(tsunAImi)’ 가속기 카드에서 사용된다고 밝혔다.

그래프코어(Graphcore), 세레브라스(Cerebras), 셀레스티얼(Celestirial) 같은 다른 회사들도 더 빠른 AI 계산을 위해 각각 인메모리 컴퓨팅, 대체 칩 설계, 빛 기반 논리 시스템을 탐구하고 있다.

그래프 코어는 자사의 보우(Bow) 지능형 처리 장치(IPU) 프로세서가 “세계최초로 WoW(Wafer on Wafer) 3D 적층 기술을 사용한 프로세서로서 IPU의 검증된 이점을 한 단계 끌어올렸다. 컴퓨팅 아키텍처와 실리콘 구현, 통신 및 메모리의 획기적인 발전을 특징으로 하는 각 보우 IPU는 최대 350테라플롭스(1테라플롭스=초당 1조회 연산)의 AI 컴퓨팅을 제공하며, 이전 세대 IPU에 비해 성능이 40% 향상되고 전력 효율성이 최대 16% 향상됐다”고 소개했다.

물론 기존 CPU의 최강자 인텔도 가만히 있는 것만은 아니다.

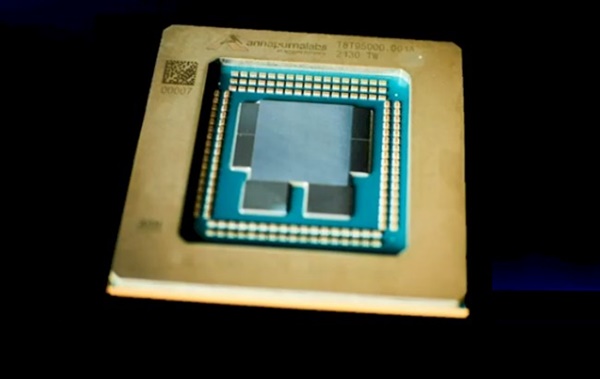

인텔은 지난해 5월 자사의 하바나 랩스(Habana Labs)를 통해 AI 딥러닝 프로세서 기술에 초점을 맞춘 2세대 AI 훈련용칩(하나바 가우디2) 및 추론용 칩(하바나 그레코)를 출시했다.

삼성전자 등 우리나라도 AI반도체 선점에 속도

삼성전자는 지난 2021년 세계 최초로 AI용 HBM-PIM칩을 발표했다. 이어 지난해 12월 열린 ‘2022 PIM인공지능반도체 전략기술 심포지엄’에서는 “2023년에 ‘HBM3-PIM’을 만나볼 수 있을 것”이라고 밝혔다.

HBM(High Bandwidth Memory)은 주로 슈퍼컴에 사용되는 메모리 반도체이며, HBM-PIM은 여기에 PIM(Processing-in-Memory) 기술을 적용한 칩이다.

PIM 기술은 차세대 AI반도체로 불린다. 데이터를 저장하는 메모리 반도체에 프로그램을 연산을 처리하는 프로세서를 합쳐 메모리 반도체가 데이터 저장은 물론 프로그램 연산까지 할 수 있도록 함으로써 AI훈련과 추론 효율을 높이도록 했다.

2021년 2월 삼성전자가 개발해 발표한 HBM-PIM은 2세대 고대역폭 메모리 반도체인 HBM2에 PIM을 적용시킨 것이다. 삼성전자에 따르면 이 칩은 HBM2 대비 성능은 2배 증가했고, 에너지 사용량은 70% 감소했다. HBM3는 6.4Gbps에 이르는 처리속도로, HBM2에 비해 속도가 1.8배나 빠르다.

SK하이닉스도 지난해 6월 ‘GDDR6-AiM’이라는 PIM 반도체를 선보였다.

과학기술정보통신부는 지난해 12월 “오는 2030년까지 PIM 연구·개발에 8000억원을 투입하기로 결정했다”고 발표했다.

전세계는 이처럼 점점더 인류에게 큰 영향을 미칠 AI 시대에 대비해 더 뛰어난 AI칩을 개발해 공급하기 위해 치열하게 경쟁중이다.

소셜댓글