[AI요약] 사람들의 생각보다 AI 기술의 발달은 꽤 빠르게 진행되고 있다. 이를테면 음성만으로 사용자의 감정이나 성별, 나이를 감지해낸 다면, 혹은 학교에서 교사가 학생들을 지도할 때 표정이나 대답 만으로 이해 여부와 집중도를 파악할 수 있게 된다면 어떨까? 실은 이러한 기술들은 이미 개발되거나 개발이 진행 중이다.

“다시 한 번 말해주세요” “잘 이해하지 못했어요”

이제까지 인공지능(AI) 스피커는 예측 범위를 넘어서는 질문에 대해 위와 같이 답하는 것이 일반적이다. AI 기술이 일상에 적용되고 있다고 하지만 우리가 접하는 기기에 적용된 기술 수준은 아직 초보적인 단계다. 영화 <아이언맨>의 ‘자비스’와 같은 수준은 아직까지 그야말로 영화와 같은 미래 어느 시점에서나 가능할 것이라는 게 일반적인 예측이다.

하지만 의외로 그 시기가 빨라질 수도 있다. 사람들의 생각보다 AI 기술의 발달은 꽤 빠르게 진행되고 있기 때문이다. 그렇다면 그 수준은 어떨까? 이를테면 음성만으로 사용자의 감정이나 성별, 나이를 감지해낸 다면, 혹은 학교에서 교사가 학생들을 지도할 때 표정이나 대답 만으로 이해 여부와 집중도를 파악할 수 있게 된다면 어떨까?

실은 이러한 기술들은 이미 개발되거나 개발이 진행 중이다. 사용자의 감정이나 성별, 나이를 감지하는 것은 글로벌 음원 플랫폼으로 알려진 스포티파이가 이미 특허를 등록했고, 학교에서 적용되는 AI 기술은 인텔이 개발하고 있는 솔루션이다.

AI가 감정을 이해한다는 의미는?

KT는 최근 연내 ‘초거대 AI’를 바탕으로 한 KT ‘AI 2.0’을 선언했다. 현재 △청각지능 △언어지능 △클라우드 △시각지능 등으로 나눠진 AI 기반 기술 고도화를 통해 ‘공감능력’을 기반으로 인간과 상호작용하는 AI를 개발하겠다는 계획이다. 초거대 AI는 대용량 데이터를 스스로 학습해 인간과 같은 종합적 추론을 할 수 있는 차세대 AI를 뜻한다.

KT는 이미 2020년 출범한 산학협력체 ‘AI 원팀’을 바탕으로 다자간 공동연구를 통해 초거대 AI 모델을 개발하고 있다. 최근 연내 상용화 방침을 대외적으로 밝힌 것은 그간의 연구 성과가 적지 않았음을 의미한다.

KT가 설명하는 초거대 AI 모델 기반의 네 가지 핵심 기술 중 감정을 이해하는 기술은 청각지능과 언어지능으로 대표된다. 청각지능의 경우 KT가 자체개발한 ‘E2E 음성인식’ 기술이 적용됐다. 예상되는 질문이 아닌 말하는 사람의 자유 음성을 실시간으로 처리하는 것이 핵심이다.

잘 듣는 것이 가능해진 다음에 중요한 것은 이해하고 답하는 것이다. KT가 언급한 언어지능은 바로 그런 기능을 한다. AI가 어휘 변용 문장을 자동 생성해 스스로 학습 성능을 높이는 문장 생성 기술이 적용된다. 특징은 특정 질문에 대해 매번 동일한 것이 아닌, 사람처럼 다른 대답을 할 수 있다는 것이다. 여기에는 문장 요약 기술도 적용됐는데, 이는 상담 내용을 이해하고 응대하는 시간을 획기적으로 단축할 수 있는 것으로 알려졌다.

KT는 이를 활용해 육아나 법률 등 전문적인 분야에도 AI가 사람처럼 연속적인 대화를 할 수 있게 하는 ‘멀티턴 전문 상담’ 서비스를 개발한다는 계획이다. KT에 따르면 이는 문의자의 감정과 대화 맥락을 고려해 대응할 수 있는 기술이다.

배순민 KT 융합기술원 AI2XL 연구소장은 “정보만 얻기 위해 AI를 쓰는 것이 아니라 자신에게 위로가 될 수 있고, 어려움에 대해 공감해 주는 AI를 통해 삶을 더 풍부하게 만들어가는 단계로 넘어가야 한다”며 “필요한 말과 하지 말아야 할 말을 구분하는 똑똑한 AI, 따뜻한 AI, 디지털 휴먼 등을 만들어 AI레벨을 올리는 것이 KT의 ‘AI 2.0’”이라고 설명했다.

차세대 AI, 무한 기술 경쟁 시대로 접어들었다

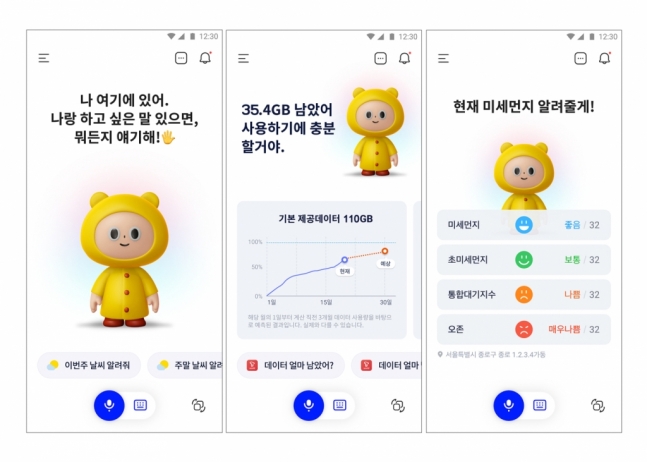

KT와 마찬가지로 미래 경쟁력 확보를 위해 나서는 다른 많은 기업들이 AI 기술 개발에 총력을 기울이고 있다. SK텔레콤의 경우 최근 쌍방향 대화가 가능한 2세대 AI 기술, ‘에이닷(A.)의 베타버전을 출시했다. 이는 기존 SK텔레콤의 AI 스피커 ‘누구(NUGU)’를 넘어선 것으로 사용자와의 대화 맥락과 감정을 학습해 “기분 어때?” “밥 먹었어?”와 같은 질문을 먼저 하기도 한다. 경우에 따라 사용자의 감정 상태에 따라 적절한 음악, 영상 서비스를 알아서 추전하는 것도 특징이다.

네이버 역시 ‘초거대 AI’ 기술 개발 경쟁 주자로서 자사 초거대 AI ‘하이퍼클로바’를 기반으로 한 ‘아바타 챗봇’을 개발 중으로 알려졌다. 대화 중심의 기존 텍스트 챗봇과 달리 이는 독자적인 외형, 성격, 말투를 가진 캐릭터가 개성을 갖고 소통하는 방식이다. 이를 통해 네이버는 대화의 맥락을 이해하는 것은 물론 캐릭터의 표정 등으로 비언어적 소통까지 가능하게 한다는 계획이다. 네이버는 이러한 ‘아바타 챗봇’을 메타버스 플랫폼 제페토의 패션, 웹툰, 게임, 공연 등 각종 콘텐츠와 결합해 사업을 확장한다는 방침을 세우고 있다.

한편 글로벌 기업으로서 AI 기술 개발의 대표 주자인 구글의 경우 지난 11일 개최된 ‘구글 I/O’ 개발자 행사를 통해 차세대 AI 스피커 ‘룩앤톡(Look and Talk)’를 공개했다. 기존 ‘헤이 구글’과 같은 호출어가 필요 없다는 것이 특징이다. 단지 AI 스피커를 보고 말을 하면 스피커가 얼굴을 인식해 답을 한다는 것이다.

코로나19 시대에 확산된 비대면 문화로 성장한 화상회의 서비스 줌(Zoom) 또한 자사 시스템에 감정을 이해하는 AI 기술 ‘Zoom IQ for Sales’를 적용 계획을 가지고 있다.

AI가 감정을 읽는다는 것, 다 좋을까?

세계는 코로나19 팬데믹이라는 시기를 거치며 더 큰 폭의 기술적 진보를 경험하고 있다. 기술 혁신의 동력이 전쟁과 질병이라는 말이 실현되는 시대인 셈이다. 앞서 각 기업들이 제시하는, 인간의 감정을 읽는 AI가 출연하면 다양한 분야에 도움이 될 것은 분명하다.

하지만 그러한 AI가 모두 자비스 같지만은 않을 것이라는 우려도 있다. 일각에서는 감정을 이해하는 AI 기술의 부작용을 지적하기도 한다. 디지털 권리 옹호 비영리단체인 파이트 포 더 퓨처(Fight for the Future)의 캠페인 총괄 케이틀린 실리 조지(Caitlin Seeley George)는 감정을 이해하는 인공지능의 차별성을 우려하기도 했다. 아무리 고도화된 AI라도 동일한 표정, 음성 패턴, 몸짓 언어를 기준으로 할 수밖에 없고, 그렇게 되면 다른 문화와 인종, 개성을 가진 사람들을 차별하게 된다는 것이다. AI 기술이 악용될 여지가 적지 않다는 점도 언급되고 있다.

이러한 이유로 이 단체는 줌(Zoom)의 공동 창업자이자 CEO인 에릭 유안(Eric Yuan)에게 공개서한을 보내 “줌의 AI 기술 적용 계획은 특정 인종이나 장애가 있는 사람을 차별하고 수백만 개의 기기에 고정관념을 심어 놓을 것”이라며 “유저를 마이닝해 기업의 영리활동에 이용할 뿐 아니라 회의 참가자의 동기나 의욕을 평가하는 잔인한 방법으로 사용될 수 있다”고 지적하기도 했다.

실제 우리나라에서도 그 예를 찾아볼 수 있다. 지난해 AI 챗봇 ‘이루다’의 성소수자와 특정 인종에 대한 혐오 표현이 문제가 됐다. 또 법무부에서는 내·외국인 얼굴사진 1억7000만건을 본인 동의없이 활용해 개인 식별·추적 시스템을 만들어 논란이 일었다.

이와 관련 최근 우리나라 역시 유럽연합(EU)와 유엔(UN) 등에서 인공지능의 인권침해 위험 통제를 위한 법제화 움직임에 발맞춰 국가인권위원회(이하 인권위)에서 ‘인공지능 개발과 활용에 관한 인권 가이드라인’을 발표했다. 이는 ‘생체식별’ ‘살상용’ 등 초고위험 AI를 금지하는 것을 골자로 하고 있다. 문제는 늘 그렇듯 제도가 만들어지는 속도보다 기술이 발달하는 속도가 더 빠르다는 점이다.

소셜댓글